サーバ擬人化ユーザ会としての活動停止とVRでの新しい活動について

サーバ擬人化ユーザ会は、ここしばらく活動が低迷していましたが、改めて考えなおした結果、現時点ではその役割を終えたと判断し、サーバ擬人化ユーザ会としての活動は停止して、新しい可能性を探す方へと舵を切ることにしました。

サーバ擬人化ユーザ会は、今回の冬コミでは「胡椒少々塩少佐ークル(仮)」として4日目(12月31日)に南ナ39aにてサークル参加していますが、今後当面はVRメインのサークルとして活動していくつもりです。

私は真面目に何かを書こうとすると、非常に理屈っぽく難解な文章になってしまいがちなので、本当はこれまでのサークル活動のような別の表現方法が取れればいいのですが、今回は文章でご容赦ください。

サーバ擬人化ユーザ会の活動停止について

まずは活動停止の経緯をざっくりと説明したいと思います。

サーバ擬人化ユーザ会は、2011年から時代の斜め先を行く「擬人化ユーザインターフェース(GUI)」の普及を目指して活動を開始し、ざびたん(Zabbixの擬人化)、インフラエンジニア双六に代表されるインフラエンジニア向けのボードゲームを作成してきました。

それまでのインフラエンジニアとITシステムの関係は、殺伐としたものでした。システム障害の時には、障害が起きたという事実だけが告げられ、それを復旧させたとしてもそれが当然のことのように誰からの感謝の言葉もありませんでした。(ただ、インフラエンジニアがサーバに名前を付けて愛着を持って見守る文化はありました。)

その現状に対して、私たちはインフラエンジニアとITの新たな可能性を模索し、まずはインフラエンジニアのために、システム障害の時には「アラートではなく応援を」、「システムを復旧させたらねぎらいの言葉を」というスローガンとして「ざびたん」を発表しました。単にシステムの情報を投げるだけではなくて、それを人の行動を勇気づけるものへと昇華させ表現するプロトタイプです。

www.slideshare.net

www.slideshare.net

ただ、その時の私もさすがにITシステムの主流がこの方向で来るとは思っていませんでした。複雑化したシステムは、アプリケーションコードとして管理され、できるだけ意図を組んだ自然言語の形で表現されるようになるべきということ自体は、ネタではなく、それなりに考えた結論ではあったのですが。

しかし、なんとこの10年の間に、私たちが考えた以上に世界の主流は擬人化ユーザインターフェースとなりました。

システムの運用方式では数年前からChat Opsが登場し、そこでは、障害通知もシステムとの対話を促すメッセージの一つとなり、システムと話すように障害の対応からアプリケーションのデプロイなどなどがエンジニア同士がチャットをしているシステムの中でチャットボットとの対話で行われます。

また、ITインフラはそれ自体が抽象化されて実際物理的な実装が隠蔽されたうえで、アプリケーションの一つとして運用されるようになり、インフラエンジニアはSRE(Site Reliability Engineer)と形を変え、インフラは固定的なものではなく、常に変化しつづけ、一定の障害が起こることを折り込み済みで運用されるプログラマブルなレイヤの一つとなり、日常的に触れるインターフェースはより高高次となりました。

よりユーザーフレンドリーなインターフェースが求められるコンシューマーレベルでは、AI技術の発展により、Siri、Google Home、Alexaなど、システムに疑似的な人格が与えられ、自然言語による対話で操作できるようになってきています。

おそらくもうこの流れは変わらないでしょう。今後、さらに研究が進み、より洗練された擬人化ユーザインターフェース(今世間でいうところの「AI」)が発展してくると思われます。

このように斜め先を走っていたつもりが、現実の方が思った以上にこちら側に近づいてきたため、もはやサーバ擬人化ユーザ会として何かネタをやっても、虚構新聞のネタが現実になってしまうような形になるのは否定できません。(たとえば、今新しくざびたんを見た人にとっては、Chat OpsとAIスピーカーの劣化版みたいにしか見えないと思います)

そのため、活動をあまり行わなくなってからしばらく経ちましたが、次にやれそうなことも見つけたので明示的に活動停止することにしました。

今後の活動について

今後の活動ですが、唐突に思うかもしれませんが、結論としてはVRが中心になります。

そもそも今回「胡椒少々塩少佐ークル(仮)」で出したのは、サーバ擬人化ユーザ会としてやれることを思いつかなかったためのその場の思い付きに過ぎなかったのですが、実際やってみると私たちの活動のうち、まだやり残していることはVRに向いていそうだと思うのと、端的に私自身がVR沼にハマってしまったと認めざるを得ないからです。

サーバ擬人化ユーザ会のもう一本の活動の軸は、これもあまり明示的には言ってきませんでしたが、インフラエンジニアとしての体験の共有、コミュニケーションの促進でした。その考えのもとに製作してきたのが、インフラエンジニア双六をはじめとするインフラエンジニアゲームシリーズです。

これは自分自身のゲームに対するスタンスなのですが、私は「ゲームはコミュニケーションツール」と考え、その考えのもとゲームをしたり作ったりしてきました。

コミュニケーションが苦手な人にとってはゲームは、決められたルールのもと安心して相手とコミュニケーションをとれる場になります。また、ゲームの中にシナリオを織り込むことで、ただ話を聞いただけではわからない疑似体験をゲーム上で行うことができます。(インフラエンジニア双六は、TRPG的な会話が参加した人の実体験に基づいて行われることを意図したマスの配置になっていましたし、インフラエンジニアの野望は元ネタを知っている世代が次の世代に歴史を語ってくれることを期待したり、元ネタを知らない人が興味を持って調べてくれることを意図したりしていました)

ゲームをする時間が無駄というようなことをいう人がいますが、私自身はゲームを楽しむこと、つまりコミュニケーションを楽しむことが人生の究極の目的だと思っています。

そして、それをゲームの作りに全力で組み込んだことが、一見出オチのネタゲームに見える私たちのゲームが実際に多くの人の遊んでもらえた理由だと考えています。

また、私たちが活発にゲームを作っていた時期は、IT勉強会が広がっていく途中で、また、技術者による同人活動も一部のコミュニティに限られていて、潜在的にはニッチな技術書のニーズがあるにもかかわらず、多くの人が同人誌をオタクの一部の趣味だと認識して手をつけていない状態でした。

今や技術系同人誌が数百部売れるのは普通になりましたが、それまでは技術系同人誌は一部のマニア向けで身内にしか売れないというのが常識だったと思います。

しかし、今は技術書同人を出すのが普通の文化として受け入れられるようになって、技術書典のような企業が背景となる技術書専門のイベントまで開かれ、超満員になるようになりました。そんな中で、私自身は同人誌・同人ゲームとして斜め先の何を出せるのかが見えなくなっていました。

そういう中、最近VR(特にVRChat)に触れ、自分がゲームで表現したかったコミュニケーションツールや体験の共有をより高いレベルで実現できる可能性を感じるようになりました。

まだ私自身可能性の範囲が判断できていないため、何ができるのか具体的にできていませんが、私のゲームに対するスタンスを表現する場としてVRを活用していきたいと思っています。

私自身は、言葉で語ること自体は得意ではなく、そうするとどうしても理屈っぽくなってしまうので、これから先は作ったものや行動で伝えていければと思ってます。

また、時代の斜め先を開拓して、そっちに世界を引き込むようにしていきたいと思うので、今後もよろしくお願いできればと思います。

MySQL 5.7 以降のユーザー名の最大文字数は32文字

この記事はタイトル出落ちです。

MySQLのユーザー名の最大文字数を調べようとすると、MySQL 5.6 以前の16文字という情報しか引っ掛からないのでカッとなって書きました。

MySQL 5.7 以上では、ユーザー名は最大32文字まで使えます。

ソースはこちら。

MySQL :: MySQL 5.7 Reference Manual :: 6.2.1 Account User Names and Passwords

MySQL :: MySQL 8.0 Reference Manual :: 6.2.1 Account User Names and Passwords

MySQL user names are up to 32 characters long.

MySQLの公式マニュアルは、なぜか5.6までしか日本語版が出ていないので、「MySQL ユーザーID 最大」とか「MySQL ログインID 最大」あたりの日本語でググると、そっちの「 MySQL ユーザー名は、最大で 16 文字の長さまで指定できます。」という方が引っかかっちゃうんですよね。ブログ記事とかも当時のことを書いたものばかりが引っかかります。

最近はユーザー名に読めば役割がわかるような名前を使うことも多いので、16文字だと足りないこともしばしば。32文字だと足りないことはまずないので、新しいシステムでは長いユーザー名を使っています。

日本語記事がないとまたググっても見つからなくなるので、メモ代わりに。

Amazon Linux 2 に mosh をインストールする

Amazon Linux 2は、正式リリースでは amazon-linux-extras から EPEL が入れられるようになったので、EPEL 入れて mosh を入れようとしたら動かなかったのでメモ。

結論としては、現時点では EPEL の mosh は現時点では使えないので、依存パッケージ入れてビルドすべし。

インストール方法

取り急ぎ、インストール方法は以下の通り。このブログを書いている時点の情報なので、実行する前に EPEL の mosh が動くようになっていないかなど確認してくれると吉です。

tar.gz アーカイブから入れる場合

sudo yum install protobuf-devel zlib-devel gcc-c++ ncurses-devel openssl-devel wget https://mosh.org/mosh-1.3.2.tar.gz tar xf mosh-1.3.2.tar.gz cd mosh-1.3.2 ./configure make sudo make install

※ダウンロードするアーカイブは、公式サイトから実行時に確認。

gitリポジトリのソースから入れる場合

sudo yum install protobuf-devel zlib-devel gcc-c++ ncurses-devel openssl-devel sudo yum install git autoconf libtool git clone https://github.com/mobile-shell/mosh cd mosh ./autogen.sh ./configure make sudo make install

原因

EPEL の mosh を実行しようとすると、以下のエラーが出て動かない。

mosh-server: symbol lookup error: mosh-server: undefined symbol: _ZNK6google8protobuf11MessageLite25InitializationErrorStringEv

この事象は、moshのリポジトリに登録されていて、protobufのバージョンがEPEL の mosh と合っていないのが原因の様子。ただ、そもそも、EPELのパッケージはAmazon Linux 2 で動くことを意図していないので、Amazon 側に対策してもらった方がよいのでは、という流れ。ただ、Amazon としても、EPELリポジトリのパッケージを動くことを保証していないので、必要な人は自分でビルドするのがよさげです。

Mosh server crashing on Amazon Linux 2 (AMI) · Issue #1026 · mobile-shell/mosh · GitHub

最初に紹介したビルド方法に必要な依存パッケージは、親切な人がここに書き込んでくれたものを全面的に参考にしました。

ここ見れば、すべて解決すると思いますが、GithubのIssueだと見つけるのも一手間なので、エントリにしてみました。

それでは。

【注意喚起】これからは日本でマイニングに参入してもほとんどの人は損をする

現在のGPUマイニングは、収益的には非常に厳しい状況

これまでブログでは、直接的な表現をしてきませんでしたが、ある意味正直なこんな記事が出ていたので、それに載っかってはっきりと注意喚起を。主に、6月に書いた記事に検索でたどり着く人向けです。

このマイナー太郎さんのマイニングリグの記事は、非常によく書かれていて、マイニングリグを組もうとする人には非常に重要な情報源だと思います。しかし、同時にマイニングの現実もさらっと正直に書かれており、マイニングに必要な電力とある程度のチューニングを行った場合の収益が以下と述べられています。

- ピーク消費電力は850W程度

- 報酬レートは1.70mBTC/Day

これを元にざっくり利益率を見積もった結果が以下です。

- 電気料金を1kWhあたり25円とすると、1日の電気料金は510円

- BTCのレートを高く見積もって50万円/BTCとしても、一日の収入は850円

- その差額の340円が一日の収益

一方、このマイニングリグを作るのにかかったお金は記事上の見積もりを合算すると263900円。BTCを高く見積もり、かつ、収益が低下しないとしても、コストの回収に2年以上(776日)かかる計算になります。

当然のことながら、マイニングの収入はこの数ヶ月で急速に減少したように、今後も日に日に低下していくことになります。そのため、2年経っても当初投入した資金は回収できないというのが、つまり現在のマイニングリグの見通しだと思います。この数値は私のGPUマイニングの結果とも合致しています。*1

マイニングブームの時には、何もしないでお金が儲かるというあおり記事が多かったように思いますが、やはりそうならなかったというのが厳然たる事実でしょう。

現実には、マイニングブームが起こったあとに二匹目のドジョウを追った人は安く電気が使える人だけが初期投資が回収できるかどうかというラインで、多くはこのように投資を回収できない状態になっていると思われます。

マイニングブーム以前に、このような動きを見通してマイニングを初めていた人や、すでに別の用途で使うためにGPUを持っていて、利益率が高かった時だけそれをマイニングに振り向けることができた人が一番得したはずです。

国内でのGPUマイニング事業は現状では絶望的

そもそも日本は電気代が国際的な平均値程度のため、日本国内でマイニングをしても、電気代が安い国にはかないません。電気代が安くなる特区でもできてくれればと思ったりしますが、今の政治状況でそういう判断は望めないでしょう。

そのため、国内でのGPUでのマイニングは事業としてやることはもはや絶望的だと思います。なので、すでに設備投資をしていて、この程度の収入でも問題ないと判断できる人以外はマイニングへの参入はおすすめできません。

6月時点では、こんな記事を書きましたが、それが維持されたのはせいぜい7月ぐらいまででした。

私としては、直近の数ヶ月は、ASICであればマイニングで現実的な収益を上げることはできそうですが、その先はまた考えているところです。また、GPUでのマイニングもそもそもこれだけでお金を儲けることを狙っていなかったので、趣味の延長&冬場の暖房代わりとして細々とは継続しています。

この記事は注意喚起とタイトルに入れましたが、多くの人が電力程度のコストで仮想通貨のインフラを支えるというのは、本来あるべきマイニングの姿でもあると思うので、余剰な設備で余力の範囲でマイニングに参加するのはいいことだと思います。ただ、身を削ってまでやるものではないので、変な期待を持って参加する人が増えるのは止めたいというのがこの記事の趣旨です。

暗号通貨の世界に「二匹目のドジョウ」はいない

とすると、この状況で勝つ方法が気になるところだと思いますが、正直それを記事にするのは難しいと思います。というのも、この動きの早い暗号通貨の世界で、誰かが解説記事を書いた時点で旬は過ぎていて、私が何かを見つけたとしても、それを記事した時点では情報が古く、すでに「二匹目のドジョウ」になっている可能性が大だからです。

ただ、だからこそ、自分で情報収集して、誰にも頼らずに判断できれば、まだまだいろいろとチャンスはあると思っています。個人的にはこのような混沌とした状況は楽しいので、非常に歓迎です。

ちょっと冷や水を浴びせるような記事になってすみませんが、最近加熱しすぎなところもあるので、たまにはこんな記事もよいかなと思い、つらつら書いてみました。

*1:マイナー太郎さんも、このように数値を書いてくれたのは、それを読む人が判断できるようにするためではないかと勘ぐってしまいます。

Antminer L3+ の運用を開始して半月経ったのでメモ

Twitterにも速報的に書きましたが、今月の半ばにBitmainサイトから注文していたライトコインマイナー*1のAntminer L3+が無事に届きました。

届かない可能性も含めて心配していましたが、結局、関税で5%かかった以外は特に何事もなくUPSで届きました。

電源はPC用の1200W電源を利用。ただし、PC電源はマザーボード相当の負荷がかかっていないと停止してしまうため、そのためだけにダミーのマザーボードを挿し、スイッチをつけています。

また、私はライトコインを直接マイニングするのではなく、NiceHash経由でマイニングパワーを販売することにしたので、以下のブログの通り、NiceHash向けの設定を行いました。

設定の時にちょっとはまって、英語サイトをググってもまさに必要な情報がなかったので、おそらく世界的に需要はあると思い、その設定記事だけ簡単な英語記事を書きました。

これで半月運用できたので、メモを残しておきます。

結局、儲かってるの?

暗号通貨の未来への投資が今回の大目標ではあるにしても、この記事を読んでくれている人の多くは、それが気になっていると思います。

結論としては、現時点ではGPUマイニングと比較すると遙かに高い利益率(電気代比)となっています。ただし、最近急速のライトコインの全世界のハッシュパワーが上昇しており、この間のBitmainサイトを中国語版含め、定期的に見ていた限りでは、年内に累計で万近いのオーダーでAntminer L3+が出荷されるようなので、電力対マイニングフィーの利益率は急速に下がる見通しです。

金額のことを直接書くのははばかられるので、NiceHashのアフィリエイトリンク経由で、現在の収益を確認してくださいませ。ほぼ、ここの数字の通りの金額になっっています。

Sell Hashing Power on NiceHash

正直なところだと、買った時期がよかったので、先に届いた分はきっちり元が取れそうですが、これから届く分は長期運用で利益を出すことを覚悟しないといけない状況だと思っています。

また、私はコミケへの出店をきっかけに個人事業主にもなっていて、マイニングはその事業の一つに位置づけて行う予定で、得た収益は事業収益にする予定ですが、そうではない人がASICマイニングに参入する場合は、それなりに大きなお金が動くので確定申告をどうするかまで考えてから始めることをおすすめします。

運用で苦労しているところ

Twitterに書きましたが、ノイズと熱風がすごいです。10年前のサーバ専用機ぐらいの激しい音が出て、ファンヒーターを常時つけっぱなしにするぐらいの熱が出るので自宅に設置する場合はクーラーがある専用のマイニングルームを用意しないと継続的にマイニングするのは難しいと思います。私はこの手の環境には慣れているので、あまり気にしないで一緒に生活していますが…(-_-)

また、機械自体は思っていた以上に安定していますが、PCの延長線上にあるGPUマイニングリグとは異なる専用の機械なので、電気配線も熱を帯びないように配慮したり、チップの温度管理を行ったりといったことへの考慮が必要です。マシンが安全のためデフォルトでは80度を超えると自動的に落ちるように設定されているので、急に暑くなった日は半分程度ボードが止まってしまったりしたこともありました。

モニタリングは、Web画面からできるので、定期的にステータス確認して問題なく動いていることを確認した方がよいです。

また、管理コンピュータの中身は普通のLinuxなので、詳細確認画面を開くと、普通にtopの実行結果が画面に出力されたりして、面白いです。

Antminer L3+は、ASICマイナーの中では、1台あたりの消費電力が800Wと低めなので、比較的運用しやすい機器ではあると思います。たとえば、最近人気になっているAntminer D3は1台あたりの消費電力が1200Wなので、一般的な家庭のコンセント・ブレーカーの場合は1台で1サブブレーカー占有するような配線でないと安全に運用するのは難しいと思います。

実際に運用してみて、少なくとも自宅サーバの運用やGPUマイニングを独力でできるぐらいの知識と経験が必要になるように思いました。

ライトコインをマイニングできるのはやはりテンションが上がる!

いろいろ前置きを書きましたが、GPUでのマイニングを始めた時にも感じましたが、暗号通貨が自宅でマイニングできるというはテンションが上がりますね。それだけでも買った価値がありました。

特に、今後の暗号通貨の中心になる(と私が勝手に思っている)ライトコインをマイニングし、自宅で見つけたブロックに記録されたトランザクションが全世界に網の目のように広がって、それが「お金」になっていると思うと、想像が膨らみます。

また、こうやってマイニングに参加することで、BitmainがBitcoin Cashを準備している裏で、実はそれと真逆の動きにもなるライトコインマイナーを大量に準備していたことがわかったりと、情報を眺めているだけではわからない動向も感じ取ることができています。 マイニングは、実世界の電力と引き換えに「仮想」のコインを作り出す行為で、そのためのハッシュパワーの動きは事実として動かないので、非常に重要な情報源だと感じています。

また、今後マイニングフィーが下がっていくのが見えているのは残念ではありますが、一方で、これが今の世界の動きの速さで、ちょっとの判断の遅れが大きな差を生むということも合わせて実感できました。

中間まとめとして

とにかく、今は2台だけですが、自宅でもASICマイナーを長期運用するめどをつけることができました。

すでに、いくつか追加注文しているので、順次設備が増強される予定です。

今の家だと限界なので、追加分については実家の空き部屋を活用したりする予定になっています。

データセンターを借りることも検討してみましたが、これだけの電力を使うとなると、データセンター代が高くなるので、一般的なサーバホスティングのデータセンターでは採算がとれないので断念しました。

セキュリティレベル低めでも、電力が大量に使えて、PUEが低いような専用の作りでないとデータセンターで採算を取るのは難しいのではないかと感じています。そのため、今は小規模にその要件にあう環境を自宅に作るのが最適かなと。

こういうのは、規模が大きくなると格段に運用が難しくなるので、機材が増えたらまたメモ書きたいと思います。

今日はこんなところで。

ちなみに、これまでの経緯はこちら。

以下は、暗号通貨を始めたい人向けのCoin CheckとZaifのアフィリエイトリンクです。

*1:厳密にはScryptでマイニングできる暗号通貨に対応したScryptマイナー

How to use Bitmain ASIC Miner (Antminer L3+ etc.) on NiceHash mining pool

In conclusion

You must set Antminer parameters like follows:

- Set NiceHash mining pool URL generated on HashHash ASIC mining page in the URL field on Antminer’s Miner Configuration.

- Set your BTC address and “.[your worker name]” like ‘1Q6QWZx7yTfCgfbHcJGcP3ZokQwWKsMmKd.myantminer1’ in the User field.

- Set only “x” in the Password field

It is very confusing that User means your BTC payout address and the worker name on NiceHash. It was so hard to find out.

I hope this would be some of help.

If this information will be profitable for you, I will appreciate you that you consider to register NiceHash via my referral URL, https://www.nicehash.com/sell?refby=245811.

暗号通貨のマイニングのその後と現在の環境&Bitmain Antminer L3+導入計画

追記

最新話はこちら。

6月15日に、このブログを見てくれている人への最低限の情報提供として、以下ブログにポイントだけ書きましたが、暗号通貨の最近の盛り上がりとGPUでのマイニングを意図した暗号通貨のハッシュアルゴリズムやツールが出てきているおかげで、ゲーム用に最新のGPUを積んだマシンを持っている人は、追加の費用なく、暗号通貨のマイニングで収益をあげられるようになりました。

このブログを書いた時点と比べると、その後、GPUマイニングに参入する人が世界的に増えたために、暗号通貨のマイニングで得られる収益は3分の1ぐらいまで下がっていますが、それでもちゃんとメンテナンスをしている限りは、電気代を支払った上でプラスが出るぐらいの利益率は維持されています。

追記:

マイニングの利益率を気にしてブログを見に来てくれる方がいるようなので参考リンクを追加しておきます。

CPU、GPU、ASICの各機材の実際の収益は、NiceHashのハッシュパワーの値付けを見ると大体わかります。NiceHashは、ハッシュパワーを売り買いするサービスを行っており、そこで実際に支払われた収入の平均値がわかるようになっているためです。

各機材の収益のリンクはこちら。ここから「RX 580」や「GeForce GTX 1080 Ti」など、自分が使おうとしているGPUを選ぶと、現時点で得られるマイニングフィーが表示されます。ただ、GPUを選んだ場合、GPUだけにかかる電気代だけが計算されてそのほかのパーツの電気代が計算されないため、利益率は楽観的に出ることに注意が必要です。収益自体は僕が実際に得られているものとほぼ同じで正しい値だと思います。

また、Radeon RXシリーズには、AMD公式で8月23日にマイニング専用のドライバー(Radeon Software Crimson ReLive Edition Beta for Blockchain Compute Driver Version 17.30.1029 (Windows Driver Store Version 22.19.659.0))がリリースされています。試した限りでは、実質的な差はそれほどありませんでしたが、RX 580、570でマイニングしている方は、こちらのドライバーへの更新をおすすめします。

追記ここまで

自分の場合は、自宅の電気代全体をマイニングの収益で賄った上で、プラスが出ているので、今でも月々1万円程度はプラスがあると思います。

6月時点は、異常な利益率だったので、それと比べると見劣りはしますし、マイニングの維持のために暗号通貨の動向把握やマイニング機材のメンテナンスの工数はかかっているので、それも含めて考えると、同じ時間、別のバイトした方が収入は多くはなると思いますが、まあ、それはそれとして。

また新しいことも考えているので、その後の状況も記事にしておきたいと思います。

現在の自宅のマイニング環境

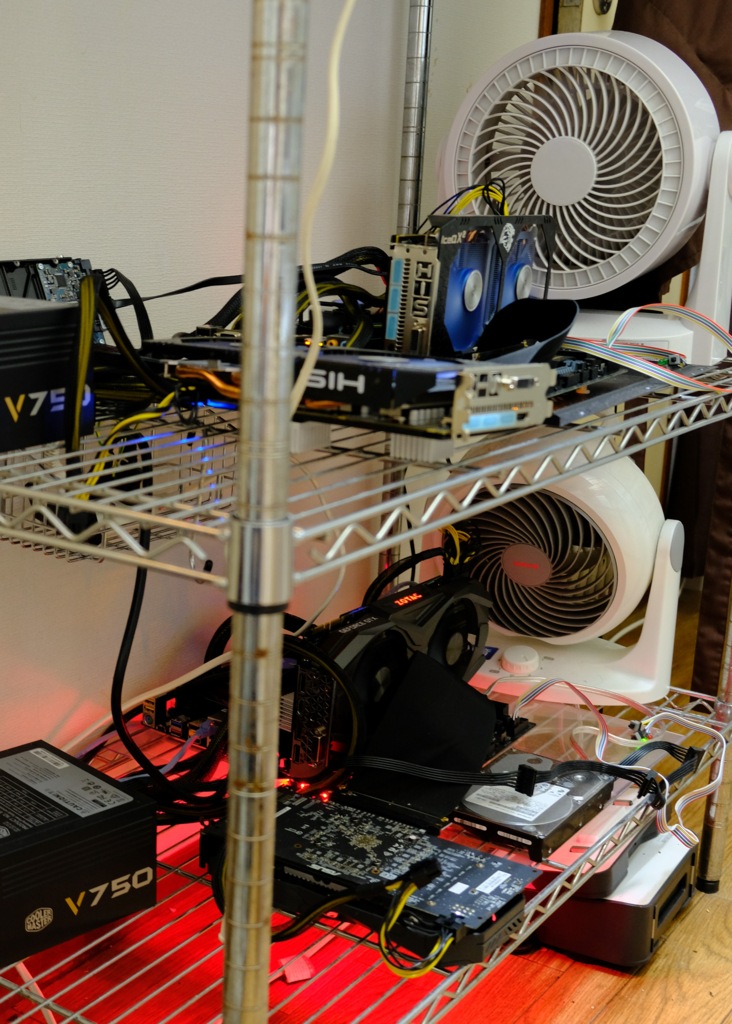

今の自宅のマイニング環境はこんな感じです。

上がRadeon RX580 × 2台。下がGeForce GTX 1080 Ti + Radeon RX570。電源やハードディスクは、むき出しで直置き、マザーボードはゲーミングマザーの修理上がりジャンク品を安く買えたのでそれを使っています。 最近のマイニング専用ボードだと、GPUの接続がPCI−e x4だったりしますが、これはGPUがx16で刺さっているので、SLIやCross Fireも動かせばちゃんと動くやつです。

そもそも、マイニング機材の知識がなく、一昔前の自作サーバの知識をベースに組み上げたので、その頃のことを知っている人にはなんとなく懐かしい感じのつくりになっています(笑)

また、マイニングを始めた当初はPCケースにちゃんとパーツを収納していたのですが、気温が高くなってきたら排熱が追いつかなくなってきたため「偉い人にはわからないが、PCケースは飾り」という結論に至って、ルミナスラックをマザーボードの直置きし、かつ、GPUの排熱部とラックを接触させて、ラック全体で排熱するというアレな感じのスタイルとなりました。

最近は「マイニングリグ」という呼び方で、1枚のマザーボードに5〜13枚GPUを指してカードをぶら下げるみたいなおしゃれなものを作ったりするみたいですが、まあ、自分としてはこれで納得。マイニングリグといっても、結局はGPUをたくさんさせるようにしただけで、中身はPCと変わらないので。

自分が家にいない間は、エアコンを止めても冷却は十分(温度起因の性能低下なし)で動かせているので、これはこれでよいのかなと思っています。

また、これに加えて、メインPCにGeForce GTX 1080 が入っているので、PCでGPUを使う作業をしない時にはそれもマイニングに使っています。それを全部合わせた収益が全体で3万円~4万円弱。電気代が実測値(>理論値)*13万円前後という感じです。

今後のプラン

GPUマイニングの見通しは電気代プラスアルファ程度だけど、健全な水準

最初にマイニングのことを紹介した記事を挙げてから、確か1週間後ぐらいにはマイニングの収益は半減、さらに2週間後には今と近い水準になり、その後、さらに利益率低下。今は、若干収益が持ち直したという状況にあります。

Twitterでつぶやいた通り、

ということで、機材選定自体は今振り返っても悪くなかったと思うので、GPUマイニングなら、電気代がまかなえるだけましで、こんなところなのかなと思います。多くの人が参加しやすいため、収益は電気代プラスアルファのところに落ち着くのは、経済的にも納得がいきますし、暗号通貨の健全な発展のためには、むしろ、今がちょうどいい水準なのかなという理解です。

世の中には、同じタイミングでGPUマイニング始めた人がたくさんいたと思うのですが、今どうなっているのかちょっと気になるところではあります。

次の一手として、9月中旬にはAntminer L3+を導入予定

で、次の手なのですが、実は前のブログを書いた直後に、「ゲーミングPCの空き時間でやることをおすすめ」と行っておきながら、BitmainのASICマシン「Antminer L3+」を注文しています。こちらは、なかなか在庫が復活せず、復活しても到着が数か月先の予定になってしまうのですが、予定通り発送されれば、9月の中旬には手元に届くはずです。

Antminer L3+は、Bitmain社が販売しているマイニング専用のコンピューターの一つです。

Antminer L3+は、暗号通貨のうち、ライトコインなどの「Scrypt」というアルゴリズムのハッシュ計算でのマイニングに対応しています。また、ハッシュ計算が、CPUやGPUのような汎用的な計算チップではなく、マイニングに特化した専用チップ(ASIC)で行われるため、CPUやGPUを大きく上回る電力対効果でのマイニングを行うことができます。

Antminer L3+には、このASICが288枚搭載されています。このようなASICを複数搭載したマシンと比べると、CPUやGPUを使った一般的なコンピューターでのマイニングは効率が非常に悪いため、すでにASICを搭載したマイニング専用マシンが市販されているビットコインやライトコインは事実上、ASICマシンでしかマイニングができないといけない状況になっています。(CPU、GPUでのマイニングでは投入した電力よりも、得られるコインの方が少ないため、マイニングを続けることが難しい)

正直なところ、このようなマイニング専用機を購入することに抵抗がなかったわけではないのですが、ライトコインのマイニングをやってみるためには他に手がないため、買ってみることにしました。

また、マイニングを開始すると同時に暗号通貨のことを調べてみて、今後の暗号通貨の動きを占う上で一番の核になるのがライトコインの動きではないかと思っています。ライトコインが盛り上がってくれると、暗号通貨全体が一番面白い展開になりそうな気がしています。

ただ、ライトコインはハッシュパワーが一部に集中していることが課題のようなので、自分がASICマシン数台買ったところで、これが変わるわけではないですが、面白い展開にもっていくための多少の力になればと思っています。

可能性があるなら、マイニングプールを運営してみたいところですが、電気代のことと、ASICは結局、中国の企業から輸入しないといけないことを考えるとなかなか手が出せないところです。もし、日本の半導体技術者で、ASICを開発してみたいという人がいたら、僕がマシンを手に入れたら、それを提供するので、競争力があるASICが開発できたらと妄想もしています。

まあ、ちゃんと個人輸入が成功するかどうかもまだわからないので、ASICが届いたら、また使ってみた結果をブログに書きたいと思います。

余談

ライトコインのことを多少詳しく書きましたが、個人的な趣味では盛り上がってほしいなと思うのは、モナコインです。

モナコインで、国内決済やウェブの投げ銭が普及したら、日本ローカルでの利用を中心としつつ、グローバルにも通用する暗号通貨として面白いと思うのですが、日本円と交換できるのが、Zaifとか限られているので、暗号通貨に全く触れていない人に流通させにくいのが惜しいところ。

今いったん止めてしまいましたが、モナコインのマイニングもしばらくやっていて、多少のMONAがあるので、盛り上がりのチャンスを見つけたいなという気持ちではいます。

今日はこんなところで。

*1:マイニングの収益計算サイトだと、理論値で電気代を計算されますが、実測値はそれよりもまあまあ大きくなることが多いので実は損していたということがないように注意が必要です。